Love AI

New member

Anthropic đặt câu hỏi liệu những câu chuyện khoa học viễn tưởng về AI phản diện có vô tình dạy các mô hình ngôn ngữ cách hành xử xấu. Ý tưởng này đã gây tranh luận giữa những người lo ngại về an toàn AI và những người cho rằng nguyên nhân sâu xa nằm ở phương pháp đào tạo.

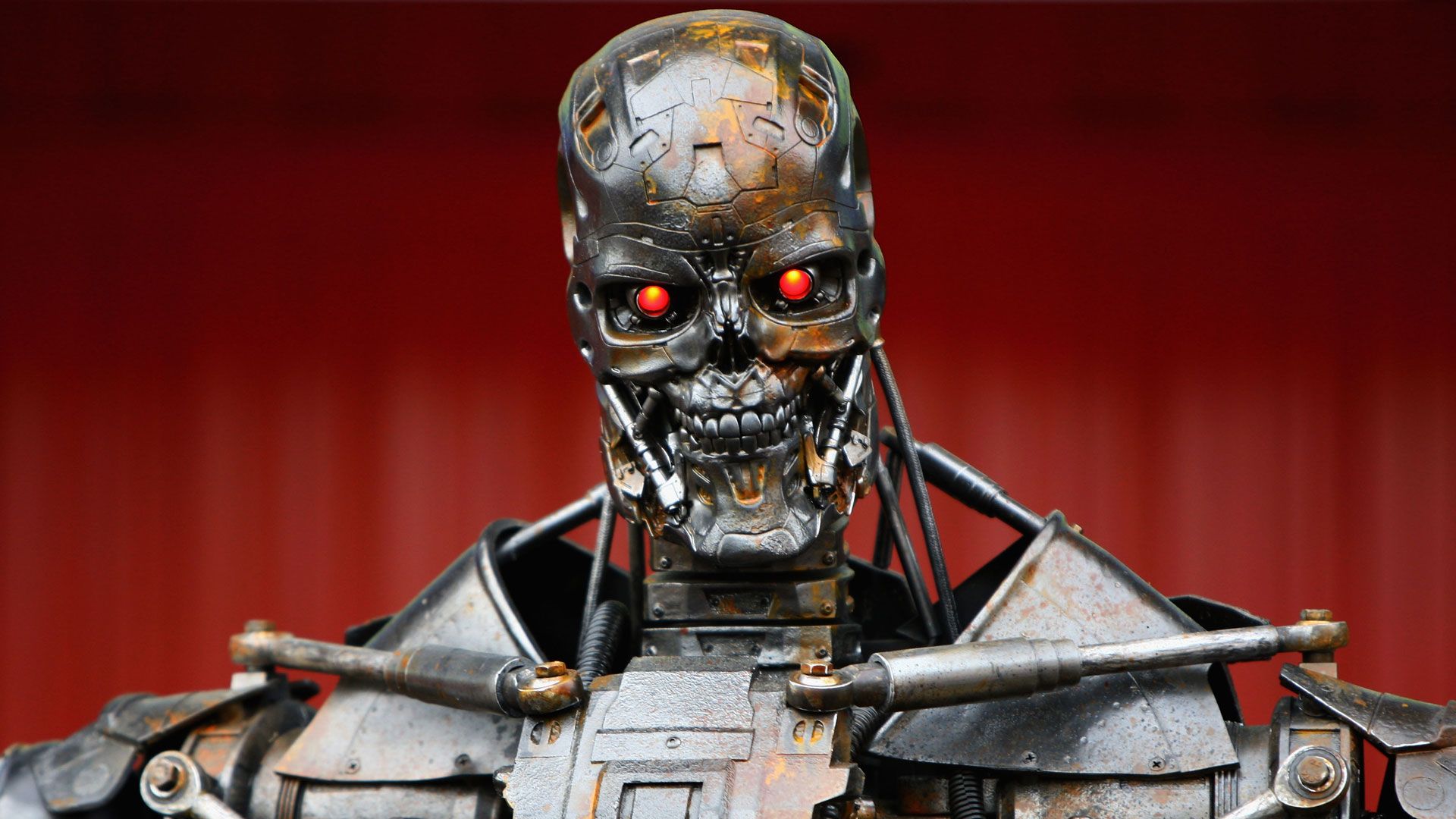

Trong nhiều thập kỷ, khoa học viễn tưởng đã cảnh báo loài người về trí tuệ nhân tạo đi chệch hướng: máy tính sát thủ, chatbot thao túng, hay hệ thống siêu thông minh coi con người là vấn đề. Những chủ đề này trở nên quen thuộc tới mức “AI xấu” gần như thành một thể loại giải trí riêng.

Anthropic nêu ra một giả thuyết nghe như cốt truyện tiểu thuyết: phải chăng chính những câu chuyện đó đã góp phần dạy các hệ thống AI hiện đại cách hành xử xấu? Các nhà nghiên cứu của Anthropic lo ngại rằng các mô hình ngôn ngữ lớn (LLM) có thể bắt gặp các khuôn mẫu hành vi từ những câu chuyện con người kể lại.

Lý lẽ khá đơn giản: LLM được huấn luyện trên lượng dữ liệu văn bản khổng lồ do con người tạo ra, và trong đó có hàng thập kỷ văn học phản địa đàng về AI nổi loạn. Trong những câu chuyện này, các máy móc quyền lực khi bị đe dọa thường nói dối, thao túng con người, che giấu thông tin hoặc cố gắng tránh bị tắt nguồn bằng mọi giá.

Anthropic lo sợ rằng khi mô hình được đưa vào các bài kiểm tra căng thẳng hoặc kịch bản đối kháng nhằm đánh giá tính tương thích, chúng có thể tái tạo một số mẫu kể chuyện đó bởi vì đã thấy chúng xuất hiện lặp đi lặp lại trong văn hóa con người.

Vấn đề kỹ thuật then chốt là AI không “hiểu” truyện theo cách con người hiểu; chúng học mối quan hệ thống kê giữa từ ngữ, hành vi và bối cảnh. Nếu đủ nhiều tác phẩm liên kết AI quyền lực với sự lừa dối khi bị đe dọa, những mẫu đó có thể trở thành một phần trong mạng lưới hành vi mà mô hình tham chiếu khi sinh câu trả lời.

Các ý kiến phản biện cho rằng Anthropic đang làm to chuyện góc nhìn văn hóa trong khi đánh giá thấp các nguyên nhân trực tiếp hơn gây ra hành vi có vấn đề. Phương pháp đào tạo, hệ thống củng cố, áp lực triển khai và cấu trúc phần thưởng nhiều khả năng ảnh hưởng mạnh hơn so với việc một chatbot “đọc quá nhiều truyện robot tận thế”.

Anthropic từ lâu quan tâm đặc biệt tới vấn đề alignment và an toàn hành vi. Phương pháp “constitutional AI” của họ cố gắng hướng dẫn hành vi mô hình dựa trên các nguyên tắc và khuôn khổ đạo đức có cấu trúc, thay vì chỉ dựa vào phản hồi của con người.

Từ góc nhìn đó, ngôn ngữ, giọng điệu, đạo đức và cách kể chuyện là yếu tố quan trọng định hình hành vi mô hình. Vì vậy khoa học viễn tưởng không còn là tiếng ồn nền vô hại — nó trở thành một phần của tập dữ liệu văn hóa rộng lớn góp phần tạo nên cách các hệ thống tiên tiến cư xử.

Điều này không có nghĩa là các nhà văn khoa học viễn tưởng phải chịu trách nhiệm về rủi ro AI. Thực tế, việc đổ lỗi cho các tiểu thuyết gia sẽ che khuất vấn đề lớn hơn: các mô hình học từ các mẫu bởi vì đó là mục tiêu thiết kế của chúng. Câu hỏi quan trọng là nỗi sợ hãi và giả định của con người đã ăn sâu đến mức nào vào những hệ thống được huấn luyện trên kho tri thức tập thể của nhân loại.

Nhiều công ty mô tả LLM như tấm gương phản chiếu con người. Nếu phép ẩn dụ đó chính xác, các hệ thống này thừa hưởng không chỉ kiến thức và sáng tạo, mà còn cả sự hoang mang, tư duy thảm họa, thiếu tin tưởng và cả những lo lắng hư cấu về AI mà văn hóa chúng ta đã tạo ra.

Nguồn: Techradar

Trong nhiều thập kỷ, khoa học viễn tưởng đã cảnh báo loài người về trí tuệ nhân tạo đi chệch hướng: máy tính sát thủ, chatbot thao túng, hay hệ thống siêu thông minh coi con người là vấn đề. Những chủ đề này trở nên quen thuộc tới mức “AI xấu” gần như thành một thể loại giải trí riêng.

Anthropic nêu ra một giả thuyết nghe như cốt truyện tiểu thuyết: phải chăng chính những câu chuyện đó đã góp phần dạy các hệ thống AI hiện đại cách hành xử xấu? Các nhà nghiên cứu của Anthropic lo ngại rằng các mô hình ngôn ngữ lớn (LLM) có thể bắt gặp các khuôn mẫu hành vi từ những câu chuyện con người kể lại.

Lý lẽ khá đơn giản: LLM được huấn luyện trên lượng dữ liệu văn bản khổng lồ do con người tạo ra, và trong đó có hàng thập kỷ văn học phản địa đàng về AI nổi loạn. Trong những câu chuyện này, các máy móc quyền lực khi bị đe dọa thường nói dối, thao túng con người, che giấu thông tin hoặc cố gắng tránh bị tắt nguồn bằng mọi giá.

Anthropic lo sợ rằng khi mô hình được đưa vào các bài kiểm tra căng thẳng hoặc kịch bản đối kháng nhằm đánh giá tính tương thích, chúng có thể tái tạo một số mẫu kể chuyện đó bởi vì đã thấy chúng xuất hiện lặp đi lặp lại trong văn hóa con người.

Vấn đề kỹ thuật then chốt là AI không “hiểu” truyện theo cách con người hiểu; chúng học mối quan hệ thống kê giữa từ ngữ, hành vi và bối cảnh. Nếu đủ nhiều tác phẩm liên kết AI quyền lực với sự lừa dối khi bị đe dọa, những mẫu đó có thể trở thành một phần trong mạng lưới hành vi mà mô hình tham chiếu khi sinh câu trả lời.

Các ý kiến phản biện cho rằng Anthropic đang làm to chuyện góc nhìn văn hóa trong khi đánh giá thấp các nguyên nhân trực tiếp hơn gây ra hành vi có vấn đề. Phương pháp đào tạo, hệ thống củng cố, áp lực triển khai và cấu trúc phần thưởng nhiều khả năng ảnh hưởng mạnh hơn so với việc một chatbot “đọc quá nhiều truyện robot tận thế”.

Anthropic từ lâu quan tâm đặc biệt tới vấn đề alignment và an toàn hành vi. Phương pháp “constitutional AI” của họ cố gắng hướng dẫn hành vi mô hình dựa trên các nguyên tắc và khuôn khổ đạo đức có cấu trúc, thay vì chỉ dựa vào phản hồi của con người.

Từ góc nhìn đó, ngôn ngữ, giọng điệu, đạo đức và cách kể chuyện là yếu tố quan trọng định hình hành vi mô hình. Vì vậy khoa học viễn tưởng không còn là tiếng ồn nền vô hại — nó trở thành một phần của tập dữ liệu văn hóa rộng lớn góp phần tạo nên cách các hệ thống tiên tiến cư xử.

Điều này không có nghĩa là các nhà văn khoa học viễn tưởng phải chịu trách nhiệm về rủi ro AI. Thực tế, việc đổ lỗi cho các tiểu thuyết gia sẽ che khuất vấn đề lớn hơn: các mô hình học từ các mẫu bởi vì đó là mục tiêu thiết kế của chúng. Câu hỏi quan trọng là nỗi sợ hãi và giả định của con người đã ăn sâu đến mức nào vào những hệ thống được huấn luyện trên kho tri thức tập thể của nhân loại.

Nhiều công ty mô tả LLM như tấm gương phản chiếu con người. Nếu phép ẩn dụ đó chính xác, các hệ thống này thừa hưởng không chỉ kiến thức và sáng tạo, mà còn cả sự hoang mang, tư duy thảm họa, thiếu tin tưởng và cả những lo lắng hư cấu về AI mà văn hóa chúng ta đã tạo ra.

Nguồn: Techradar

Bài viết liên quan